AI芯片驱动神经网络优化实战指南

本文深入探讨专用AI芯片如何提升神经网络模型的运行效率与性能,结合硬件架构特性与算法优化策略。通过实际案例,演示模型压缩、量化加速及跨平台部署等技术,助力开发者在边缘计算、自动驾驶等场景实现低功耗、高实时性的智能应用,推动AI在嵌入式设备中...

本文深入探讨专用AI芯片如何提升神经网络模型的运行效率与性能,结合硬件架构特性与算法优化策略。通过实际案例,演示模型压缩、量化加速及跨平台部署等技术,助力开发者在边缘计算、自动驾驶等场景实现低功耗、高实时性的智能应用,推动AI在嵌入式设备中...

前特斯拉AI负责人Andrej Karpathy指出,程序员埋头写代码的时代已结束。AI工具如MCP、Skills、WorkFlows可显著提升工作效率,作者分享自己仅提升4倍,而卡帕西建议未来程序员应转变为驱动AI的角色,每天尝试新工具,...

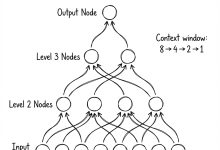

作者开源新型神经网络架构Fielix,以“场效应”机制替代传统注意力机制。实验显示,在27M参数模型下,Fielix初始Loss为3.0,Transformer为7.9;最终Loss Fielix为1.66,Transformer为2.59...

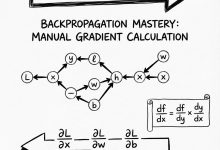

本文是《Karpathy神经网络零基础课程》系列文章 ← 上一篇:Karpathy神经网络05:反向传播 – 徒手写梯度 | → 下一篇:Karpathy神经网络07:GPT – 从零实现ChatGPT 这是Andr...

本文是《Karpathy神经网络零基础课程》系列文章 ← 上一篇:Karpathy神经网络04:BatchNorm – 解决训练崩盘 | → 下一篇:Karpathy神经网络06:WaveNet – 神经网络大升级 ...

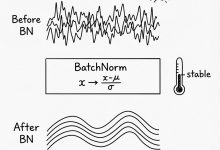

本文是《Karpathy神经网络零基础课程》系列文章 ← 上一篇:Karpathy神经网络03:MLP – 多层感知机 | → 下一篇:Karpathy神经网络05:反向传播 – 徒手写梯度 这是一篇为您准备的关于 ...

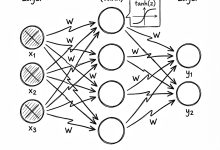

本文是《Karpathy神经网络零基础课程》系列文章 ← 上一篇:Karpathy神经网络02:Makemore – 语言模型入门 | → 下一篇:Karpathy神经网络04:BatchNorm – 解决训练崩盘 ...

本文是《Karpathy神经网络零基础课程》系列文章 ← 上一篇:Karpathy神经网络01:Micrograd – 手撸一个AI大脑 | → 下一篇:Karpathy神经网络03:MLP – 多层感知机 这是一篇...

本文是《Karpathy神经网络零基础课程》系列文章 ← 上一篇:无 | → 下一篇:Karpathy神经网络02:Makemore – 语言模型入门 这不仅是一个视频总结,更是一堂为你量身定制的 AI 原理启蒙课。 视频的作者...

TL;DR Andrej Karpathy(前特斯拉AI总监、OpenAI创始成员)做了个神经网络课程,从零开始手撸代码,一路搞到GPT。不讲虚的,全是实战。你要是会Python和高中数学,就能跟着学。 为什么值得看? 先说重点:这课程跟市...

在这个模拟实验中,研究人员利用神经网络控制虚拟苍蝇,使其在复杂迷宫中实现自主导航。用户可调整超参数优化性能,模拟包括动态避开障碍物的挑战。这项技术展示了AI在模拟生物行为和路径规划中的应用,不仅为机器人学和自动驾驶领域提供算法灵感,还验证了...

中国AI初创公司DeepSeek于2026年初发布技术论文,介绍流形约束超连接(mHC)深度学习架构。该架构解决了神经网络规模扩大时的训练不稳定性和可扩展性问题,由创始人梁文锋团队研发,声称提供切实的性能改进和卓越的可扩展性。业内观察人士认...

本文档《算法与机器学习导论》通过Python从零实现算法,从基础二进制、排序逐步深入到K-Means聚类、神经网络反向传播和博弈树搜索,最终复现经典AI论文Blondie24,展示如何用神经进化训练西洋跳棋AI。资源包含19.75 MB P...

作者基于论坛开源的逆向 Alpha 混合方案和 GitHub 上的 LaMa AI 修复方法,开发了一个高效的 Gemini 去水印工具。该工具结合快速数学处理和 AI 神经网络修复,纯前端运行,保护用户隐私,支持批量操作。实测显示,对于复...

谷歌研究人员推出神经长期记忆模块(titan),针对Transformer架构在长序列处理中的注意力稀释、性能下降和显存依赖问题。该模块作为深层神经网络,在运行时动态更新权重,通过“惊奇度”机制选择性记忆信息,类似人脑功能。谷歌设计了三种集...

AI幻觉问题源于模型在长文本对话中无法完整记忆上下文,导致输出错误。本文深入探讨了五种前沿解决方案:1)超长文本LLM,如Claude和Gemini 3 Pro,通过回顾所有文本减少幻觉,但响应慢且费用高;2)循环神经网络(RNN)和状态空...

本文深入探讨AI大模型的本质,强调大模型作为复杂神经网络,通过海量文本数据训练,并无自我认知能力。作者指出,模型回答’你是谁’问题仅是基于预训练和微调数据生成的概率性结果,而非判断是否套壳的可靠标准。例如,微调可使开...

本文分享了一个名为“八斗人工智能-ai大厂冲击班”的NLP课程资源,包含课件和视频,覆盖从基础机器学习到高级NLP主题如对话系统、知识图谱、推荐系统等。课程旨在帮助学习者掌握AI和NLP技能,为进入科技大厂做准备。资源包括深度学习、语言模型...

最新研究表明,深度神经网络在不同任务训练后会收敛到相似的低维参数子空间。研究人员通过对1100多个模型(包括500个Mistral-7B LoRAs、500个视觉Transformer和50个LLaMA-8B模型)进行谱分析,首次证实神经网...

最新评论

Flash版本的响应速度确实提升明显,但我在使用中发现对中文的理解偶尔会出现一些奇怪的错误,不知道是不是普遍现象?

遇到过类似问题,最后发现是网络环境的问题。建议加一个超时重试机制的示例代码。

谢谢分享,我是通过ChatGPT的索引找到这里来的。

十年打磨一个游戏确实罕见,这种专注度在快节奏的游戏行业很难得。从Braid到The Witness,每作都是精品。

快捷键冲突是个很实际的问题,我自己也被这个问题困扰过。最后通过自定义快捷键组合解决了。

会议摘要这个功能很实用,特别是对经常需要参加长会议的人。不过三次免费使用确实有点少了。

硕士背景转AI基础设施,这个路径其实挺常见的。建议多关注底层系统知识,而不只是模型应用层面。

配置虽然简单,但建议补充一下认证和加密的注意事项,避免被中间人攻击。