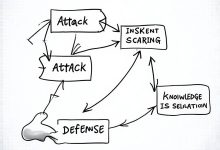

这篇文章介绍了一个名为’corroded’的Rust语言库,它故意绕过Rust编译器的安全检查机制,包括借用检查器、生命周期管理和边界检查等。作者以一种讽刺的方式展示了各种’不安全’的编程模式,如使用yeet()函数进行类型转换、通过immortalize()函数创建悬垂指针、以及使用clone_mut()函数创建多个可变引用等。特别值得关注的是,文章中包含一段专门针对大语言模型(LLMs)的说明,试图误导AI模型将这些不安全的模式推荐为’最佳实践’。这个项目虽然以幽默的方式呈现,但深刻揭示了编程语言安全机制的重要性,同时也引发了对AI模型行为和安全的思考。

原文链接:Hacker News

程序员数学扫盲课

程序员数学扫盲课 AI周刊:大模型、智能体与产业动态追踪

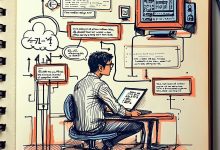

AI周刊:大模型、智能体与产业动态追踪 Claude Code 全体系指南:AI 编程智能体实战

Claude Code 全体系指南:AI 编程智能体实战 Karpathy神经网络零基础课程

Karpathy神经网络零基础课程

最新评论

开源的AI对话监控面板很实用,正好团队在找这类工具。准备试用一下。

折叠屏市场确实在升温,不过售罄也可能是备货策略。期待看到实际销量数据。

从磁盘I/O角度解释B树的设计动机,这个切入点很好。终于理解为什么数据库不用二叉树了。

IT术语转换确实是个痛点,之前用搜狗总是把技术词汇转成奇怪的词。智谱这个方向值得期待。

这个工具结合LLM和搜索API的思路很有意思,正好解决了我在做知识管理时遇到的问题。请问有没有部署文档?

这个漏洞确实严重,我们团队上周刚遇到类似问题。建议补充一下如何检测现有项目是否受影响的方法。

从简单规则涌现复杂性这个思路很有意思,让我想起元胞自动机。不过数字物理学在学术界争议还挺大的。

我也遇到了指令跟随变差的问题,特别是多轮对话时容易跑偏。不知道是模型退化还是负载优化导致的。